728x90

개요

드랍아웃(Dropout)은 딥러닝 신경망에서 자주 사용되는 정규화(Regularization) 기법으로, 모델이 학습 데이터에 과도하게 맞추는 현상인 과대적합(Overfitting)을 방지하기 위해 고안되었습니다.

내용

Dropout은 딥러닝 모델이 훈련 데이터에만 치우치지 않고, 새로운 데이터에도 잘 작동하도록 돕는 간단하면서도 강력한 정규화 기법입니다.

- 과대적합 방지: 드롭아웃을 사용하면 신경망이 일부 입력 특성(Feature)에만 지나치게 의존하지 않게 되어, 새로운 데이터(테스트 데이터)에서도 더 좋은 일반화 성능을 보임

- 앙상블 효과: 드롭아웃은 여러 개의 서로 다른 작은 신경망을 동시에 학습시키는 것과 비슷한 효과를 내어, 결과적으로 예측의 편향을 줄이고 성능을 높여줌

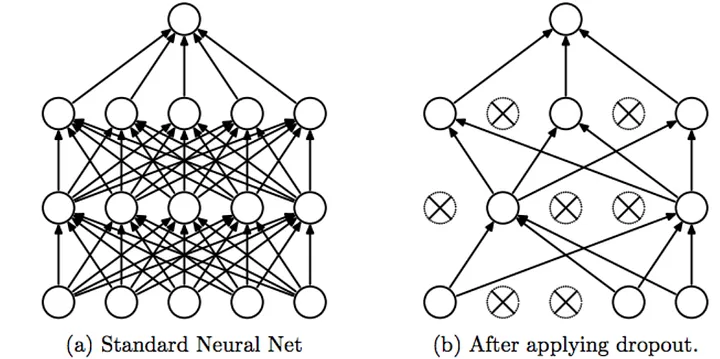

학습 과정에서 신경망의 각 레이어에 있는 뉴런(노드) 중 일부를 무작위로 "끄는"(drop, 즉 임시로 제거하는) 방식으로 동작합니다. 예를 들어, 드롭아웃 비율(dropout rate)이 0.5라면, 해당 레이어의 뉴런 중 절반 정도가 매 학습 반복마다 랜덤하게 비활성화됩니다. 이렇게 하면 특정 뉴런이나 연결에 과도하게 의존하는 것을 막고, 여러 조합의 부분 신경망이 학습에 참여하는 효과를 얻을 수 있습니다.

일반적으로 과적합을 방지하기 위해 훈련 중에 사용되며, 예측할 수 없는 성능을 초래할 수 있기 때문에 추론 중에 일반적으로 비활성화됩니다.

728x90

'AI & GPU' 카테고리의 다른 글

| Pinned Memory (0) | 2025.05.06 |

|---|---|

| 데이터 익명화 (0) | 2025.05.04 |

| RFE (0) | 2025.05.04 |

| SMOTE (0) | 2025.05.04 |

| 슬라이딩 윈도우 메커니즘 (1) | 2025.05.04 |